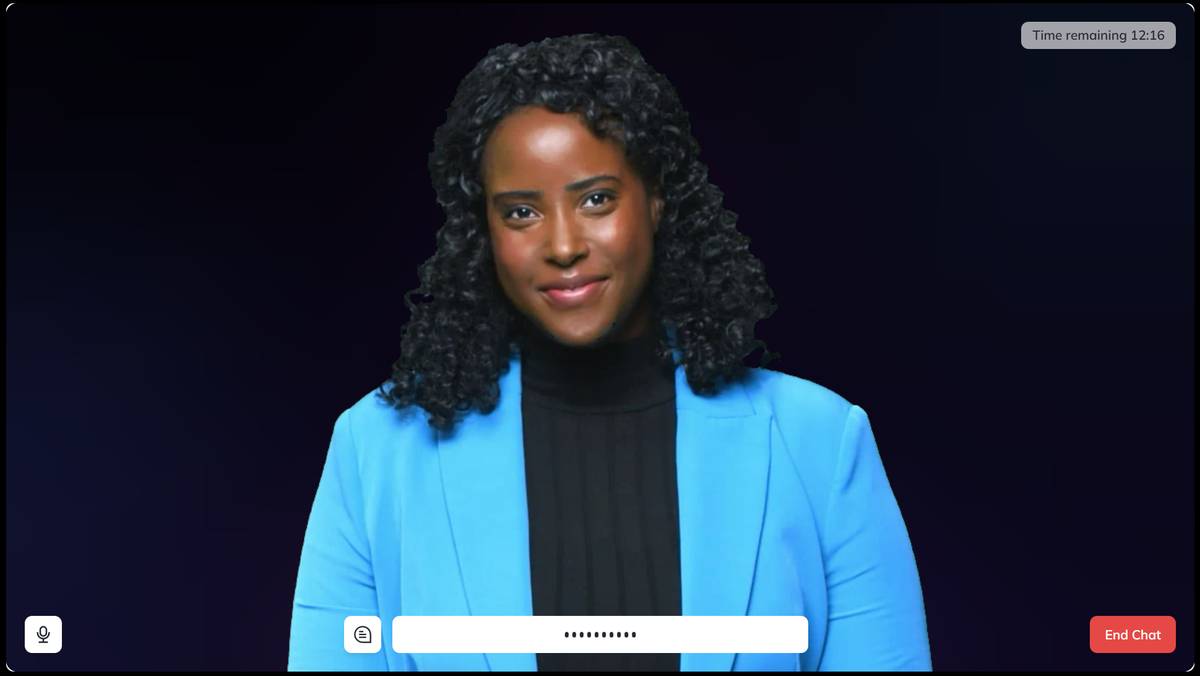

国連大学の研究機関が、難民の状況を説明するAIエージェントを開発して実験を開始したとのこと。

倫理的にかなり際どいところをついていルけれど、現実にいる難民ではなく、代理人という意図を持って生成されたエージェントを用いているところは、許容に近づく一歩だろう(英語のトーンは、おそらく現地の方の声をサンプリングして作ったのだろうけど、語る文とのマッチングに少々違和感があった)。

特定の難民のペルソナを纏って、行ってもいないことを言わせるのは危険極まりない。

殺された難民の一人を使うのならどうだろう。もちろん冒涜ではある。しかし、死者であることを明確にして、その出力を内心から徹底して切り離し、客観的な事実を対話として構成するようなことができれば――それでも受け手の私たちはその存在に「心」を感じてしまう。

やはりこのようなエージェントには、一見して人間とは異なる外見が必要ではないだろうか。

https://www.404media.co/the-un-made-ai-generated-refugees/?ref=daily-stories-newsletter